サマリー

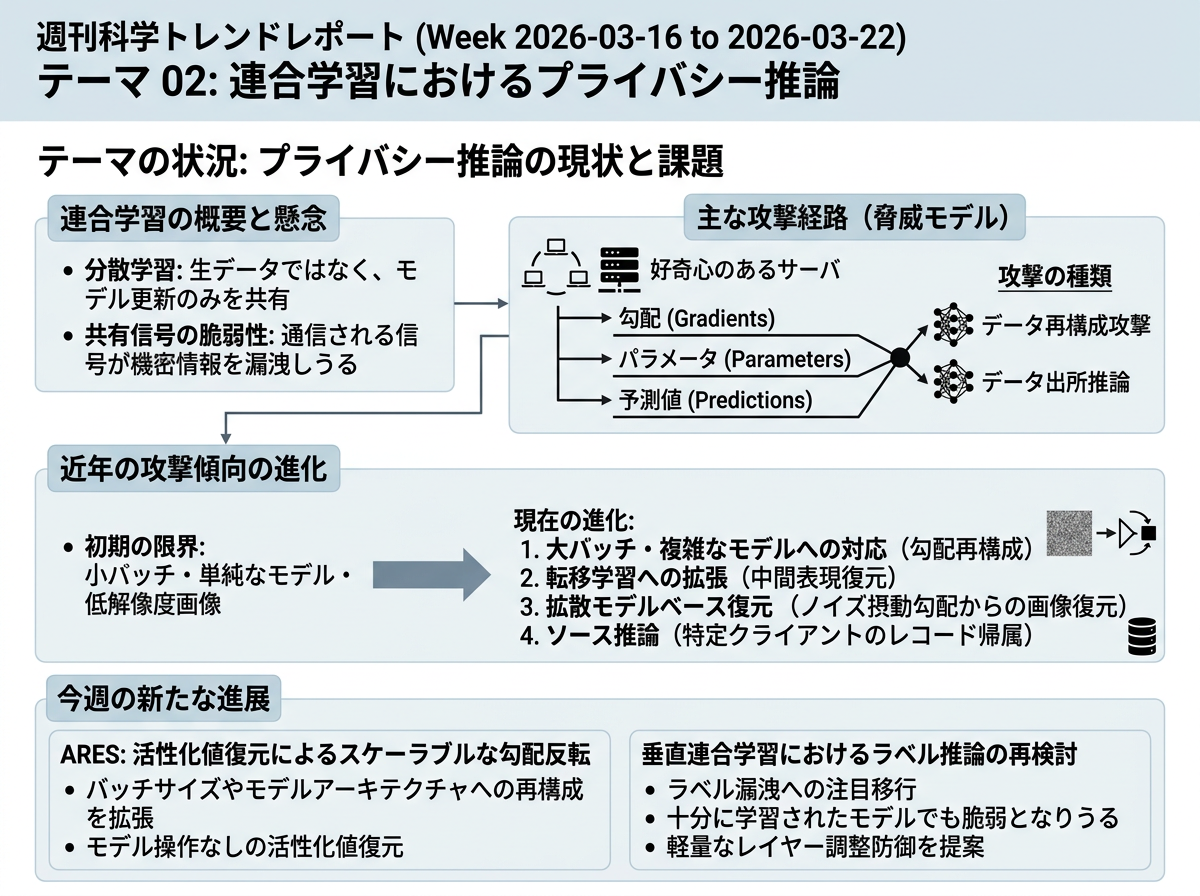

今週のテーマは連合学習におけるプライバシー評価に焦点を当てている。共有される勾配・パラメータ・予測値は、生データがデバイス上に留まる場合でも機密情報を漏洩しうる。代表的な論文は、攻撃対象を勾配反転から転移学習固有の再構成、ノイズ摂動勾配からの拡散モデルベース復元、特定クライアントへのレコード帰属を行うソース推論へと拡大している。今週の新たな進展として、活性化値の復元を通じた勾配反転のスケーラブルな設定への拡張と、垂直連合学習におけるラベル推論の脆弱性の再検討が行われた。

テーマの状況

連合学習は、生データではなくモデル更新のみを共有することで、分散データ保有者間の協調学習を可能にする。しかし、複数の研究が、通信されるこれらの信号が依然として機密情報をエンコードしていることを示している。勾配はデータ再構成攻撃に利用でき、共有パラメータや予測値でさえ、特定の学習レコードをどの参加者が所有しているかを明らかにしうる。

大半の代表的研究における脅威モデルは、通常の学習通信を悪用する好奇心のあるサーバであるが、能動的なモデル操作を想定する設定もある。近年の攻撃は、大バッチ・複雑なモデル・高解像度画像に対する初期の勾配マッチングの限界を超えつつある。ある論文は中間表現の復元を通じた連合転移学習への攻撃を対象とし、別の論文はノイズ摂動勾配から画像を再構成するために条件付き拡散モデルを使用し、さらに別の論文はメンバーシップ推論からクライアント自体のソース推論へとプライバシー分析を拡張している。これらの研究は総合的に、連合学習のプライバシー評価を、学習更新がデータの内容とデータの出所の双方について何を明らかにするかを理解する問題として位置づけている。

- Source Inference Attacks: Beyond Membership Inference Attacks in Federated Learning

- MAUI: Reconstructing Private Client Data in Federated Transfer Learning

- Enhanced Privacy Leakage from Noise-Perturbed Gradients via Gradient-Guided Conditional Diffusion Models

インフォグラフィクス(日本語)

今週の進展

ARES: Scalable and Practical Gradient Inversion Attack in Federated Learning through Activation Recovery <See Details on Fugu-MT>

活性化値を復元することで、実用的な連合学習のバッチサイズやモデルアーキテクチャへの再構成のスケーリングを実現する勾配反転攻撃(ARES)を提案。 小バッチに限定されたりモデル操作を必要とする従来手法と比較して、モデルを改変することなく活性化値の復元を通じたスケーラビリティを目指すアプローチ。

Revisiting Label Inference Attacks in Vertical Federated Learning: Why They Are Vulnerable and How to Defend <See Details on Fugu-MT>

垂直連合学習におけるラベル推論攻撃を再検討し、十分に学習されたボトムモデルが効果的な攻撃を保証しないことを示すとともに、オーバーヘッドゼロのレイヤー調整防御を提案。 入力再構成やメンバーシップ/ソース推論から、垂直連合学習設定におけるラベル漏洩へと注目を移し、軽量な緩和策を導入。

今後の展望

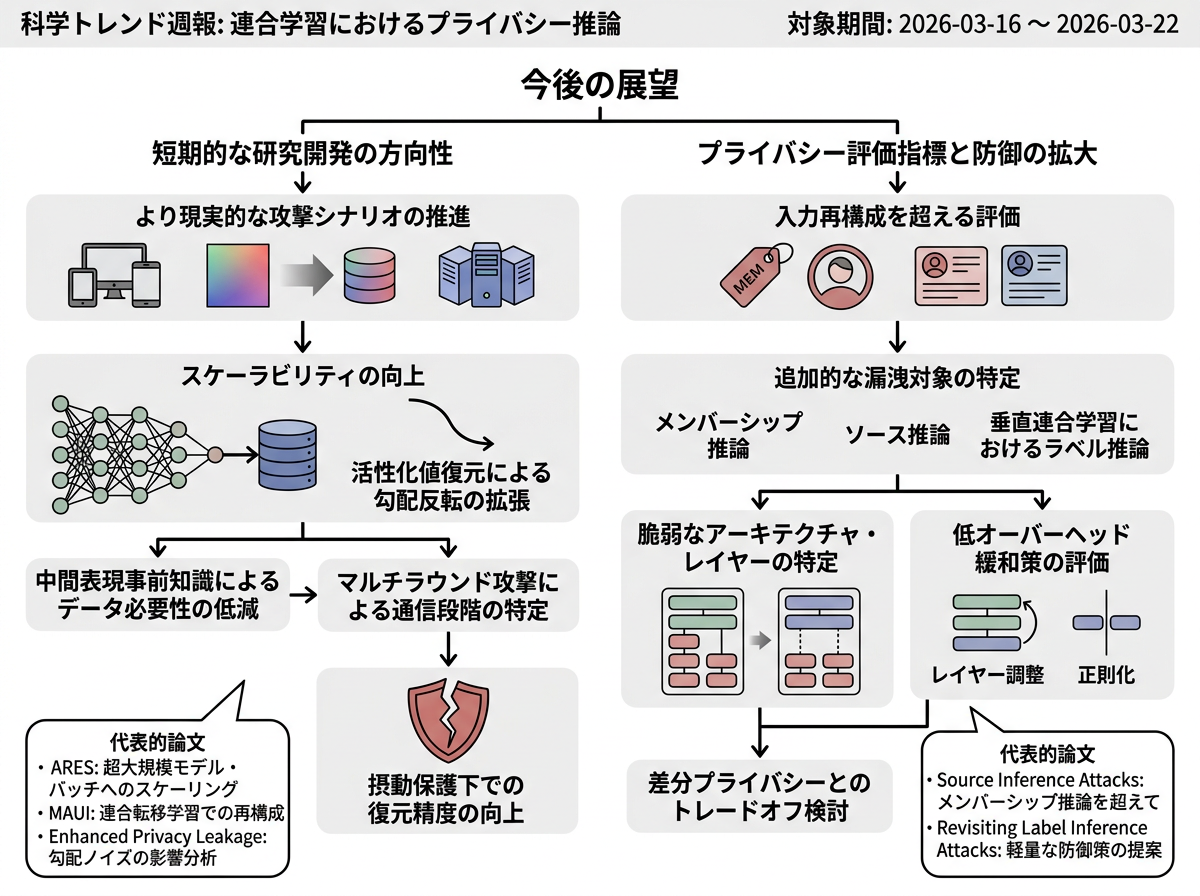

短期的な研究は、連合学習のプライバシー攻撃を現実的なデプロイ条件に向けて推進し続ける可能性が高い。今週の活性化値復元による反転結果は、中間表現マッチングや拡散ベース手法で既に見られていた方向性を補強するものである。すなわち、より大規模なモデルやバッチにおけるよりスケーラブルな再構成、および勾配摂動下でもより良好な復元である。代表的な論文が示唆する具体的な次のステップには、代表的データの必要性を低減する中間表現事前知識、分類ヘッド漏洩に対する改善されたスパース性目的関数、および最も情報量の多い通信段階を特定するマルチラウンド攻撃が含まれる。

第二の方向性は、プライバシー評価を入力再構成の先へと拡大することである。今週の垂直連合学習におけるラベル推論論文は、メンバーシップ推論やソース推論から追加の漏洩対象へと向かうトレンドを拡張しつつ、軽量な防御の必要性を強調している。今後の研究は、どのアーキテクチャや通信レイヤーが本質的に脆弱であるかを特徴づけ、差分プライバシーの既知のプライバシー・ユーティリティトレードオフに対して、レイヤー調整や正則化などの低オーバーヘッド緩和策を評価する方向に向かう可能性が高い。

インフォグラフィクス(日本語)

参照論文

- Source Inference Attacks: Beyond Membership Inference Attacks in Federated Learning - 著者: Hongsheng Hu, Xuyun Zhang, Zoran Salcic, Lichao Sun, Kim-Kwang Raymond Choo, Gillian Dobbie, / <See Details on Fugu-MT> / ライセンス: CC-BY-4.0

- MAUI: Reconstructing Private Client Data in Federated Transfer Learning - 著者: Ahaan Dabholkar, Atul Sharma, Z. Berkay Celik, Saurabh Bagchi, / <See Details on Fugu-MT> / ライセンス: CC-BY-4.0

- Enhanced Privacy Leakage from Noise-Perturbed Gradients via Gradient-Guided Conditional Diffusion Models - 著者: Jiayang Meng, Tao Huang, Hong Chen, Chen Hou, Guolong Zheng, / <See Details on Fugu-MT> / ライセンス: CC-BY-4.0