サマリー

本テーマは、LLMの出力を裏付け文書に帰属させ、生成された回答の透明性・検証可能性・信頼性を高める方法に焦点を当てている。代表的な論文群は、帰属をモデリングの問題と評価の問題の両面から捉えており、事前学習データからの検索不要の引用生成、含意スタイルのプロンプティングによるゼロショット文書帰属、そしてユーザーが引用付き回答を批判的に検証するためのインターフェースについて研究している。

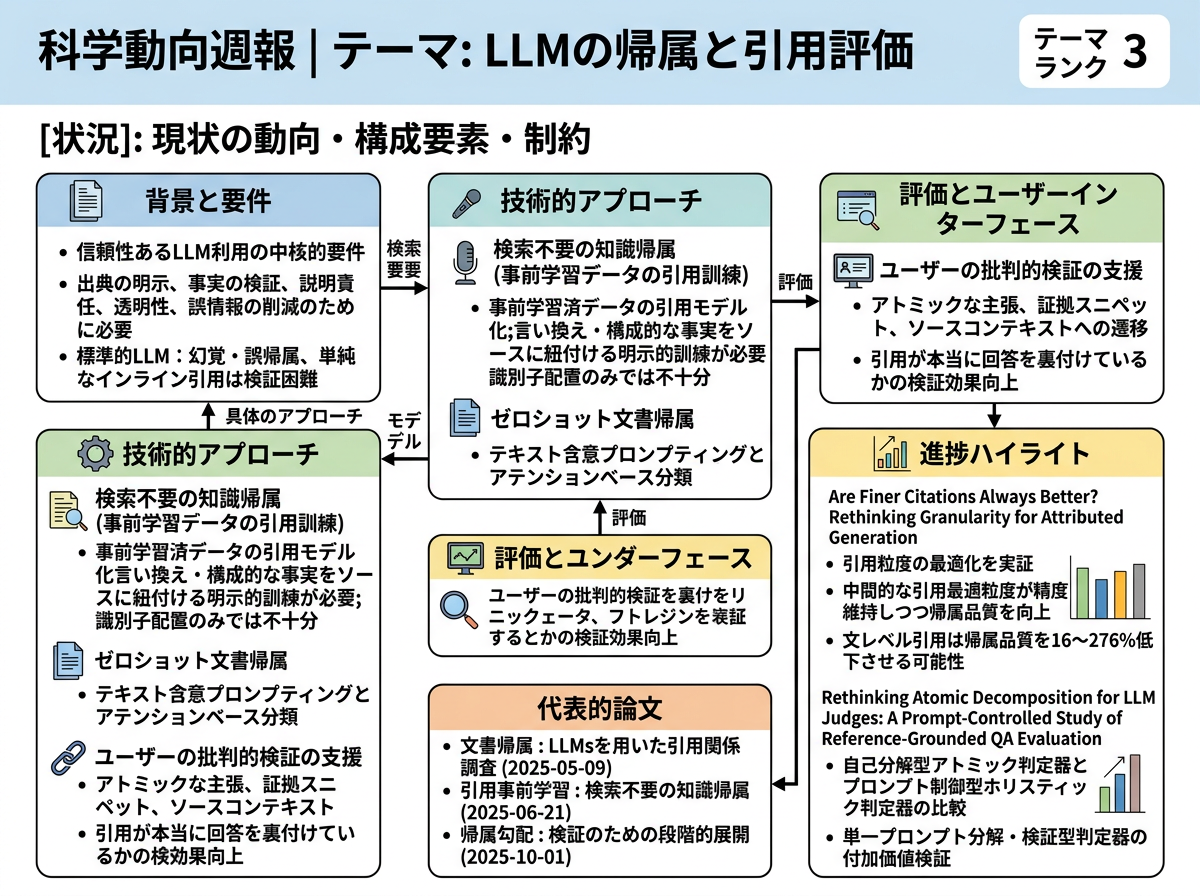

テーマの状況

近年の研究では、特にモデルが引用付きで質問に回答することを求められる場面において、帰属が信頼性あるLLM利用の中核的要件として扱われている。共通の動機は、標準的なLLMがしばしば幻覚や誤帰属を含むコンテンツを生成する一方で、単純なインライン引用は実際にはユーザーによる検証が困難であるという点にある。各論文を通じて、帰属は出典の明示、事実の検証、説明責任、透明性、および誤情報の削減のために必要であるとされている。

代表的なアプローチはスタックの複数の階層にまたがっている。一つの研究系列では、外部検索なしに継続的事前学習で学んだ文書を引用するようモデルを訓練できるかを問い、識別子の配置を細かくするだけでは不十分であり、言い換えや構成的な事実をソースに紐付けるための明示的な訓練が必要であると主張している。別の研究は、ゼロショットのテキスト含意スタイルのプロンプティングとアテンションベースの分類による文書帰属を検討している。第三の研究はユーザー向けの評価に焦点を移し、引用付きAI回答には、回答からアトミックな主張、証拠スニペット、ソースのコンテキストへと遷移するための支援が必要であり、それによりユーザーは引用が本当に回答を裏付けているかをより効果的に検証できると主張している。

- Document Attribution: Examining Citation Relationships using Large Language Models

- Cite Pretrain: Retrieval-Free Knowledge Attribution for Large Language Models

- Attribution Gradients: Incrementally Unfolding Citations for Critical Examination of Attributed AI Answers

インフォグラフィクス(日本語)

今週の進展

Are Finer Citations Always Better? Rethinking Granularity for Attributed Generation <See Details on Fugu-MT>

本論文は、引用の粒度は単に細かくするのではなく最適化する必要があることを実証し、文レベルの引用が最適な粒度と比較して帰属品質を16〜276%低下させうることを明らかにした。 従来の研究が引用機能の実現に注力していたのに対し、本研究は中間的な引用最適粒度が回答の正確性を維持しつつ帰属品質を大幅に向上させることを示した。

Rethinking Atomic Decomposition for LLM Judges: A Prompt-Controlled Study of Reference-Grounded QA Evaluation <See Details on Fugu-MT>

本論文は、参照文書に基づくQA評価において、自己分解型のアトミック判定器とプロンプト制御されたホリスティック判定器を比較した。 アトミックな主張分解が評価を改善すると想定されてきたのに対し、本研究は単一プロンプトの分解・検証型判定器が同等に詳細なホリスティック評価器に対して付加価値をもたらすかを直接検証した。

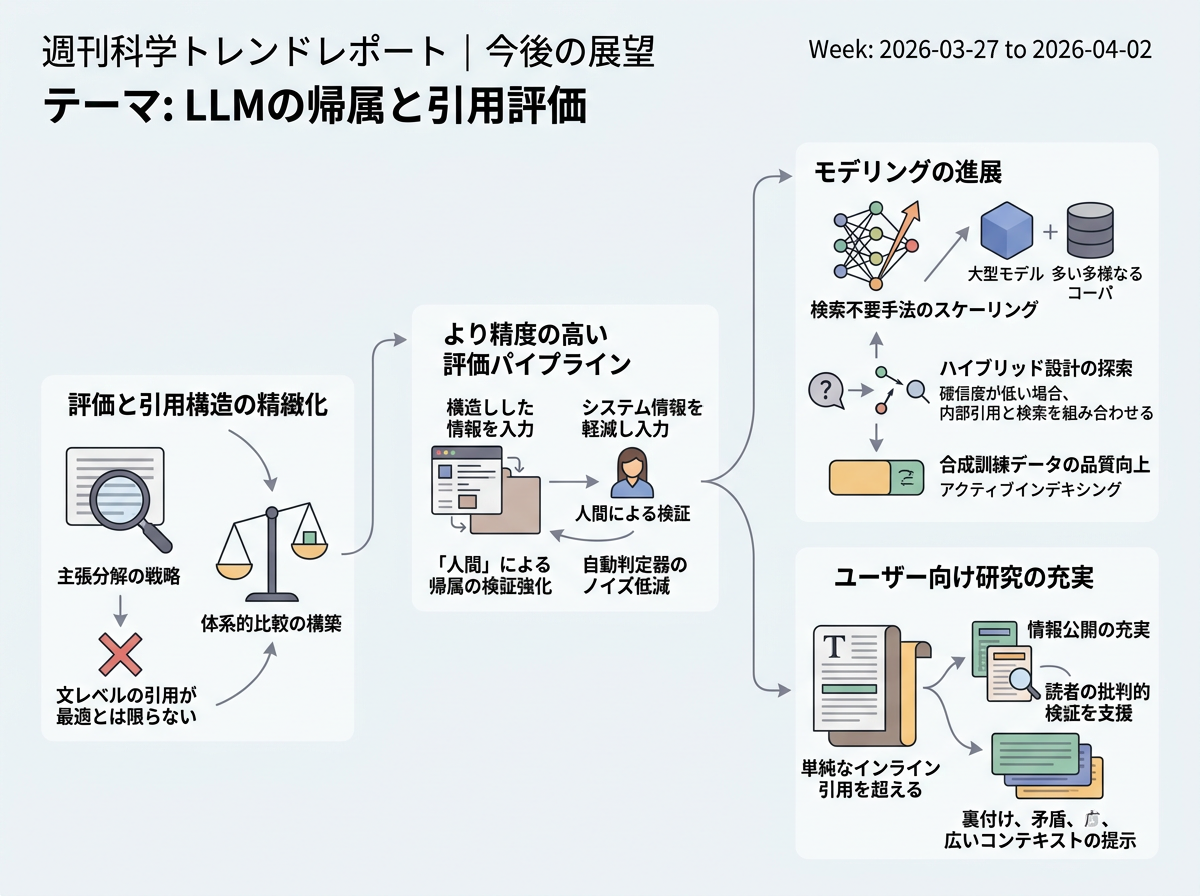

今後の展望

LLM帰属における短期的な進展は、単に粒度を細かくするのではなく、評価と引用構造をより識別力のあるものにすることに焦点を当てると考えられる。今週の知見は、文レベルの引用が常に最適とは限らず、アトミック分解は同等に制御されたホリスティック判定と比較すべきであることを示唆している。自然な次のステップとして、引用の粒度や主張分解戦略を体系的に比較する、より精度の高い評価パイプラインの構築が挙げられ、理想的には自動判定器由来のノイズを低減するために、より多くの人間による検証を組み込むことが望まれる。

モデリング側では、代表的な論文群が、検索不要の帰属手法をより大規模なモデルやより多様なコーパスへスケーリングすること、モデルの確信度が低い場合に内部引用と検索を組み合わせるハイブリッド設計の探索、およびアクティブインデキシングに用いる合成訓練データの品質フィルタリングの改善を示唆している。ユーザー向けの研究では、単純なインライン引用を超えて公開される情報を引き続き充実させ、読者が裏付け、矛盾、およびより広いコンテキストをより効果的に検証できるようにすることが期待される。

インフォグラフィクス(日本語)

参照論文

- Document Attribution: Examining Citation Relationships using Large Language Models - 著者: Vipula Rawte, Ryan A. Rossi, Franck Dernoncourt, Nedim Lipka, / <See Details on Fugu-MT> / ライセンス: CC-BY-4.0

- Cite Pretrain: Retrieval-Free Knowledge Attribution for Large Language Models - 著者: Yukun Huang, Sanxing Chen, Jian Pei, Manzil Zaheer, Bhuwan Dhingra, / <See Details on Fugu-MT> / ライセンス: CC-BY-4.0

- Attribution Gradients: Incrementally Unfolding Citations for Critical Examination of Attributed AI Answers - 著者: Hita Kambhamettu, Alyssa Hwang, Philippe Laban, Andrew Head, / <See Details on Fugu-MT> / ライセンス: CC-BY-4.0